개요

본 연구는 혼합현실(MR) 환경에서의 사용자-객체 간 인터랙션 정보를 정량화하여, 사용자의 인터랙션 만족도를 예측하고 인터페이스(UI)를 실시간 보정하는 시스템 개발 연구로,

시선, 머리, 손, 객체 정보를 통합하여 SVR·MLP 모델을 통해 사용자 제스처를와 인터랙션 만족도를 예측함

예측 결과를 반영한 반응형 인터페이스를 설계하여, 사용자 경험(UX) 품질을 향상시키는 적응형 혼합현실 인터페이스 시스템을 구현함

제안된 시스템은 HoloLens 2 장비 기반으로 Unity MRTK 환경에서 구현됨

개발된 시스템의 효과성을 검증하기 위해 총 7명의 피험자 대상으로 실험을 진행한 결과, 사용자 만족도 향상됨을 확인함

연구 목적 & 필요성

혼합현실 환경에서 사용자의 의도에 맞는 자연스러운 인터랙션은 사용자의 만족도에 큰 영향을 줄 수 있음

기존 혼합현실 환경 내 인터랙션에 대한 사용자 만족도는 사후 설문지를 통해 측정됨

→ 이는 실시간으로 사용자에게 맞는 적응형 인터랙션 환경을 제공하기에는 어려움따라서, 사용자의 인터랙션 정보를 기반으로 사용자 인터랙션 만족도 예측 후, 혼합현실 환경 내 인터페이스 UI를 실시간 보정하는 연구가 요구됨

본 프로젝트는 향후 AR/VR/MR 보급 확대에 따른 사용자 경험(UX) 최적화에 활용될 수 있음

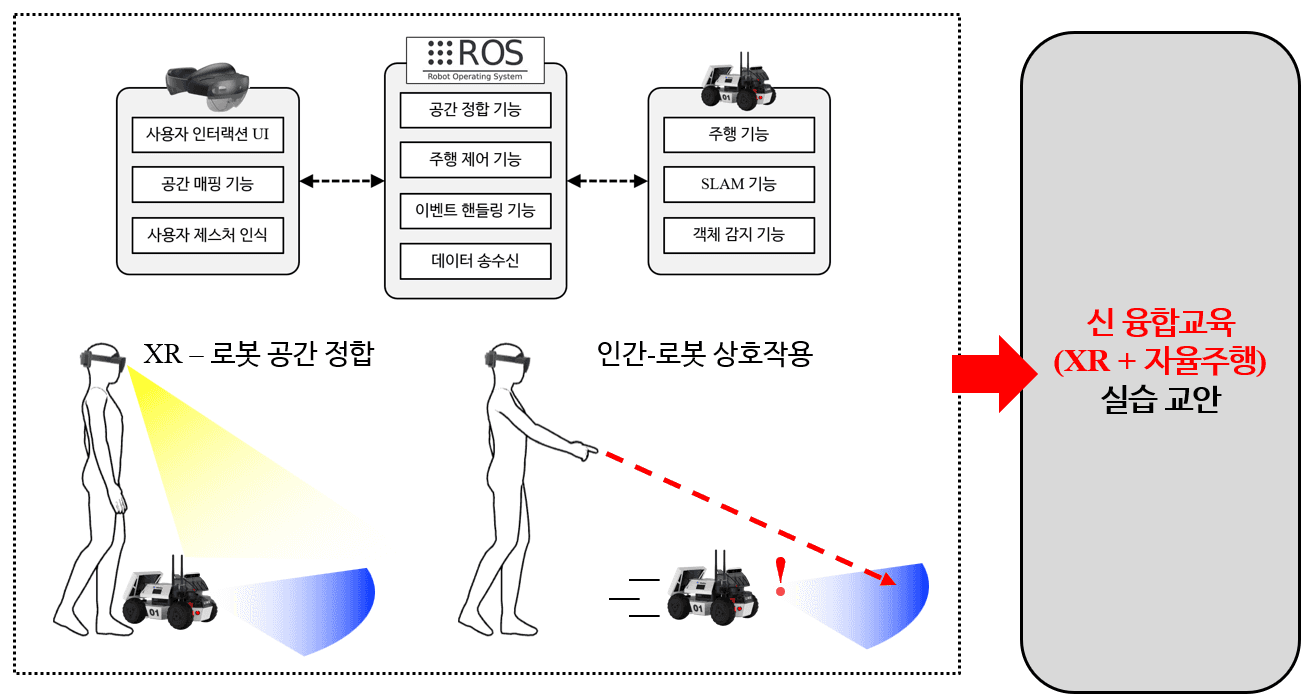

시스템 개요

본 시스템은 혼합현실(MR) 환경에서 사용자의 인터랙션 데이터를 정량적으로 분석하여, 사용자 만족도를 실시간으로 예측하고 인터페이스(UI)를 자동 보정하는 적응형 인터랙션 시스템

HoloLens 2를 활용하여 시선(Eye-Gaze), 머리(Head Pose), 손(Hand Joint), 객체(Object Transform) 데이터를 실시간으로 수집함

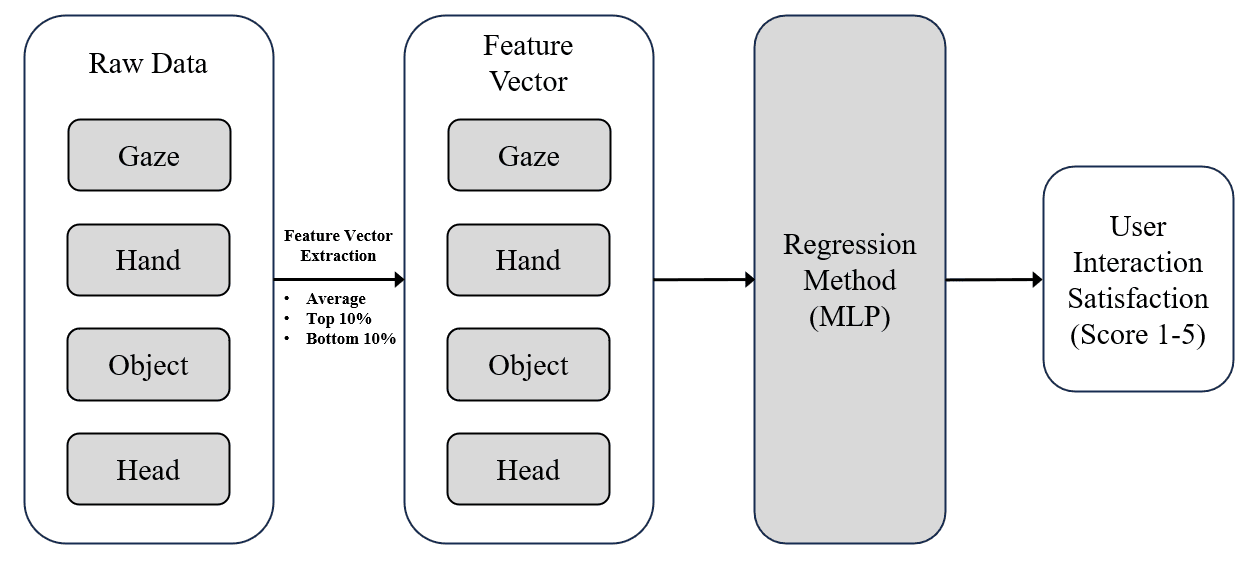

수집된 인터랙션 정보는 전처리 과정을 거쳐 특징 벡터(feature vector) 로 변환되며, MLP 기반 만족도 예측 모델에 입력되어 사용자의 실시간 인러택션 만족도를 예측함

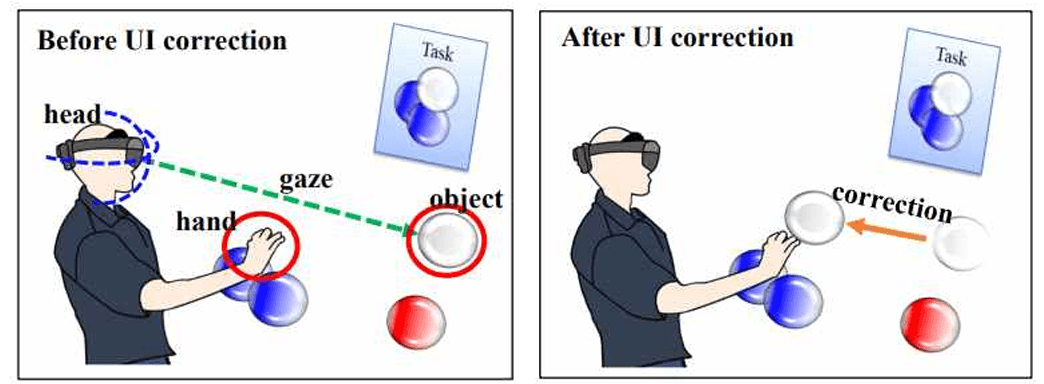

예측된 만족도가 임계값보다 낮을 경우, 시스템은 객체의 위치·크기·색상 등 속성을 자동 조정하여 인터페이스를 보정함

사용자 제스처(Pointing, Pinch, Grab)는 KNN 기반 행동 예측 알고리즘을 통해 분류되어 보정 로직과 연동됨

전체 시스템은 HoloLens 2 기반의 Unity(MRTK)로 개발됨

사용자 인터랙션 만족도 예측

데이터 수집 환경: 24명의 피험자를 대상으로 실험을 수행함. MR 환경 내에서 가상 객체 선택(Selection) 및 이동(Movement) 과제를 수행하며 시선(Eye-gaze), 손(Hand), 머리(Head), 객체(Object) 정보를 실시간으로 수집함

입력 변수 구성: 각 프레임에서 측정된 데이터는 시선, 손 관절(25 joints) 위치·회전, 머리 위치·회전, 객체 위치·회전, 작업시간(Time) 으로 구성되며, 피험자는 각 과제 종료 시 만족도(Likert 5점)를 입력함

특징 벡터 변환: 원시 데이터의 평균값, 상위 10%, 하위 10%를 특징 벡터로 변환 후 회귀 입력으로 사용

SVR 모델: 선형 커널 기반 SVR(Support Vector Regression) 모델을 통해 만족도와의 상관관계를 검증함. 피어슨 상관분석 결과, 시선·머리·손·객체 모든 요소를 포함할 때 상관계수(ρ)=0.58 로 가장 높게 나타남

윈도우 사이즈(프레임) 분석: 실시간 보정을 위해 10프레임 단위 데이터를 사용했을 때 MAE=0.654, 20프레임 대비 예측 정확도 향상 확인

MLP 모델: SVR의 성능을 보완하기 위해 다층 퍼셉트론(MLP) 기반 모델을 설계함. 은닉층 3개(32–32–8), Swish 활성함수, 최적 조건 Epoch=24, Batch=4 로 학습 시 MAE=0.531로 SVR 대비 약 18.8% 향상됨

따라서 본 시스템에서 시선·머리·손·객체 모든 요소를 활용한 MLP 모델을 사용하여 사용자 인터랙션 만족도를 예측함. 예측된 만족도가 임계값(Threshold) 이하인 경우, 객체의 위치·크기·색상 등 UI 속성을 실시간으로 보정하도록 시스템에 통합됨

사용자 제스처 예측

혼합현실(MR) 환경에서 사용자의 손동작 데이터를 기반으로 현재 수행 중인 인터랙션 유형(선택·이동)을 자동 인식(분류)하여, UI 보정 로직에 참조함

동작 유형 정의

마이크로 및 매크로 레벨 동작 인식 기법을 기반하여 사용자의 인터랙션 예측 방법 개발 (마이크로(손가락 수) / 매크로(이동 속도·패턴) 레벨의 기준으로 제스처를 분류)

선택(Selection) : 한 손 Pointing 동작 — 손가락 1~2개 사용, 이동 속도 거의 없음

이동(Movement) : Pinch 또는 Grab 동작 — 손가락 2~3개 사용, 이동 속도 보통 또는 느림

예측 알고리즘

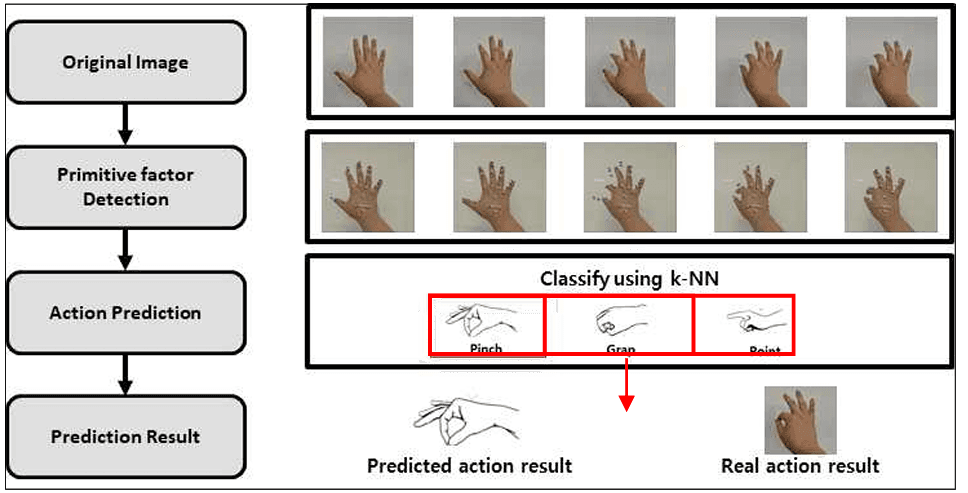

사용자 제스처 예측 파이프라인은 Original Image → Primitive Factor Detection → Action Prediction → Predicion Result 단계로 구성됨

Original Image: 연속된 5 프레임의 Raw 데이터를 측정함

Primitive Factor Detection: 핸드 키포인트 위치, 거리·각도 변화 특징(Primitive Feature)을 추출함

Action Prediction: 추출된 특징벡터를 입력으로 하여 KNN(K-Nearest Neighbor) 분류기를 적용, Pointing / Pinch / Grab 제스처 예측

Predicion Result: 분류된 제스처 결과를 UI 보정 모듈에 전달함

인터페이스 보정

사용자 인터랙션 만족도를 높이기 위한 UI 보정을 위해 사용자가 선호하는 UI 확인이 필요함

따라서 사용자 인터랙션 만족도 예측 모델 개발을 위한 데이터 수집 실험에서 수집된 데이터를 활용하여 사용자가 선호하는 UI 특성을 정량적으로 분석함

피험자: 총 24명 (20대 성인)

조작 속성(Manipulation Attributes)

선택(Selection): Pointing 제스처 (손가락 1~2개, 이동 없음)

이동(Movement): Pinch 제스처 (손가락 2개, 이동 있음)

회전(Rotation): Pinch 제스처, 객체 회전

크기조정(Scaling): 양손 Pinch, 거리 변화에 따라 크기 조절

객체 속성(Object Attributes)

위치(Position): Front/Back, Left/Right, Top/Bottom

크기(Size): Small(50%), Medium(100%), Large(200%)

색상(Color): 유사색(Similar Color) vs 보색(Complementary Color)

사용자 선호하는 UI 특성 분석 결과

비모수 통계 검정(non-parametric test) 으로 분석 (Kruskal-Wallis H-test, Mann-Whitney U-test)

우·전·하 위치의 중간 크기 객체 + 보색에서 가장 높은 만족도 확인

깊이 이동, 작은 크기 + 유사색에서 가장 낮은 만족도 확인

구분 | 비교 요소 | 주요 결과 |

|---|---|---|

조작 유형 | 선택, 이동, 회전, 크기 | 선택·회전 시 만족도 높음 |

객체 이동 | 수평, 수직, 깊이 | 수평·수직 이동 > 깊이 이동 |

객체 크기 제어 | 확대, 축소 | 축소 시 약간 더 높은 만족도 (유의미하지 않음) |

객체 위치 | 전/후, 좌/우, 상/하 | 전 > 후, 우 > 좌, 하 > 상 |

객체 크기 | 작음, 중간, 큼 | 보통, 큼 > 작음 |

객체 색상 | 유사색, 보색 | 보색 > 유사색 |

UI 보정 방법

사용자 인터랙션 만족도가 기 설정된 임계값 미만이면, 제스처 예측 결과에 따라 UI 속성을 보정함 (대응되는 보정 규칙 적용)

UI 속성 보정은 사용자가 선호하는 UI 특성에 근거하여 설정됨

보정된 UI는 실시간으로 MR 공간에 반영

실험

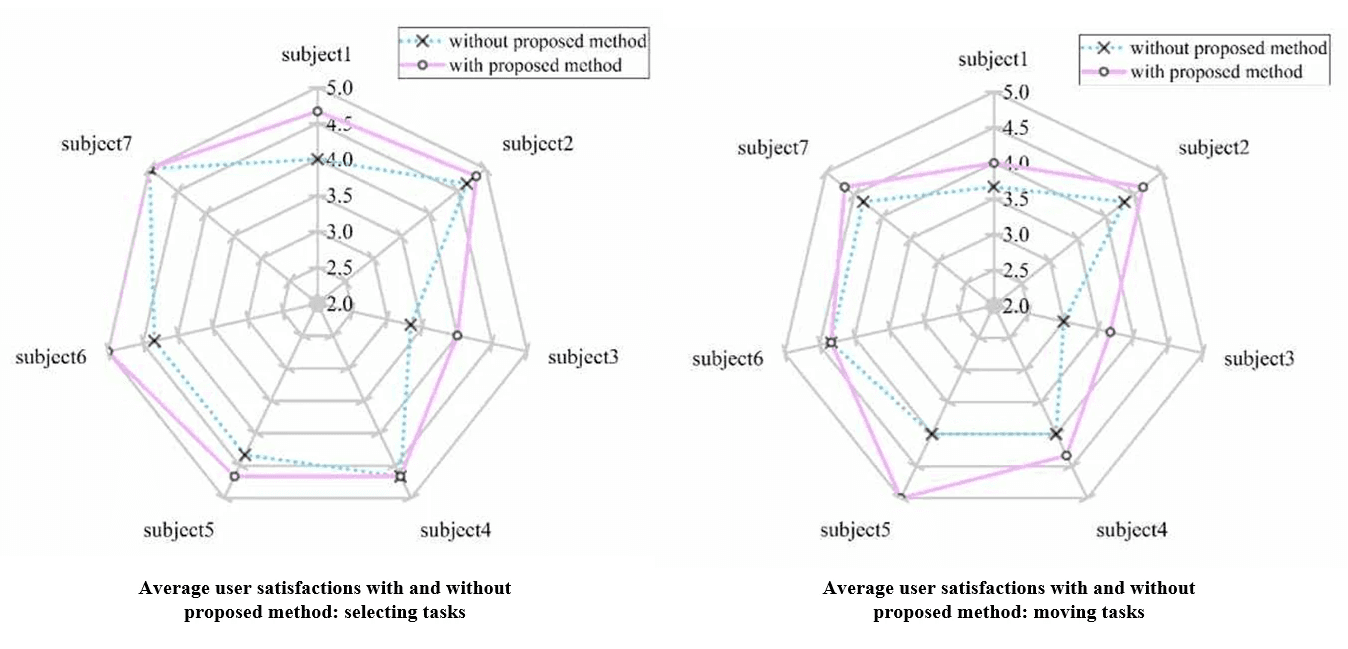

인터페이스 보정 방법을 적용하였을 때 사용자의 만족도에 미치는 영향을 분석함

피험자는 총 7명을 대상으로 수행됨

실험 과제

UI 보정 미적용 조건과 UI 보정 적용 조건(제안된 시스템)을 비교

각 피험자는 선택(Selection) 과제 3회, 이동(Movement) 과제 3회 수행 (총 48회 인터랙션)

측정 지표

주관적 만족도: Likert 5점 척도

통계 분석: Wilcoxon signed-rank test (비모수 검정, p < 0.05 유의수준)

실험 결과

구분 | UI 보정 미적용 | UI 보정 적용 | p-value |

|---|---|---|---|

선택 | 4.3 | 4.7 | < 0.05 |

이동 | 3.9 | 4.3 | < 0.05 |

보정 적용 시 모든 작업 유형에서 평균 만족도가 향상됨을 확인함

검정 결과, 선택 작업·이동 작업 모두 통계적 유의성 확인함

역할

본 연구에서는 학부연구생(학사 과정)으로 참여하여 자료 조사와 연구 동향 분석을 담당하였으며, 최종 보고서 작성 과정에서 실험 데이터 정리 및 결과 해석 보조를 수행하였다. 또한 HoloLens 기반 사용자 실험 진행에 직접 참여하여 데이터 수집과 실험 절차 운영을 지원하였다. 이러한 기여를 통해 Unity를 통한 HoloLens 개발과 전체적인 연구 프로세스를 익힐 수 있었고, 머신러닝을 기반으로 한 사용자 만족도·제스처 예측하기 위한 방법과 피험자 실험 방법 및 데이터 수집, 실험 데이터 검증 방법을 이해할 수 있었다.

본 연구는 한국전자통신연구원 “5G 기반 저지연 디바이스-엣지클라우드 인터랙션 기술 개발”의 위탁 연구과제로 수행되었습니다.